O Professor Luciano Araújo, da Universidade de São Paulo, Brasil, defendeu, no Tribunal de Contas de Angola, uma abordagem prudente, responsável e institucionalmente orientada da inteligência artificial generativa, sublinhando que a sua adopção só será útil e legítima se estiver subordinada às exigências do controlo público, da segurança jurídica e da protecção das pessoas.

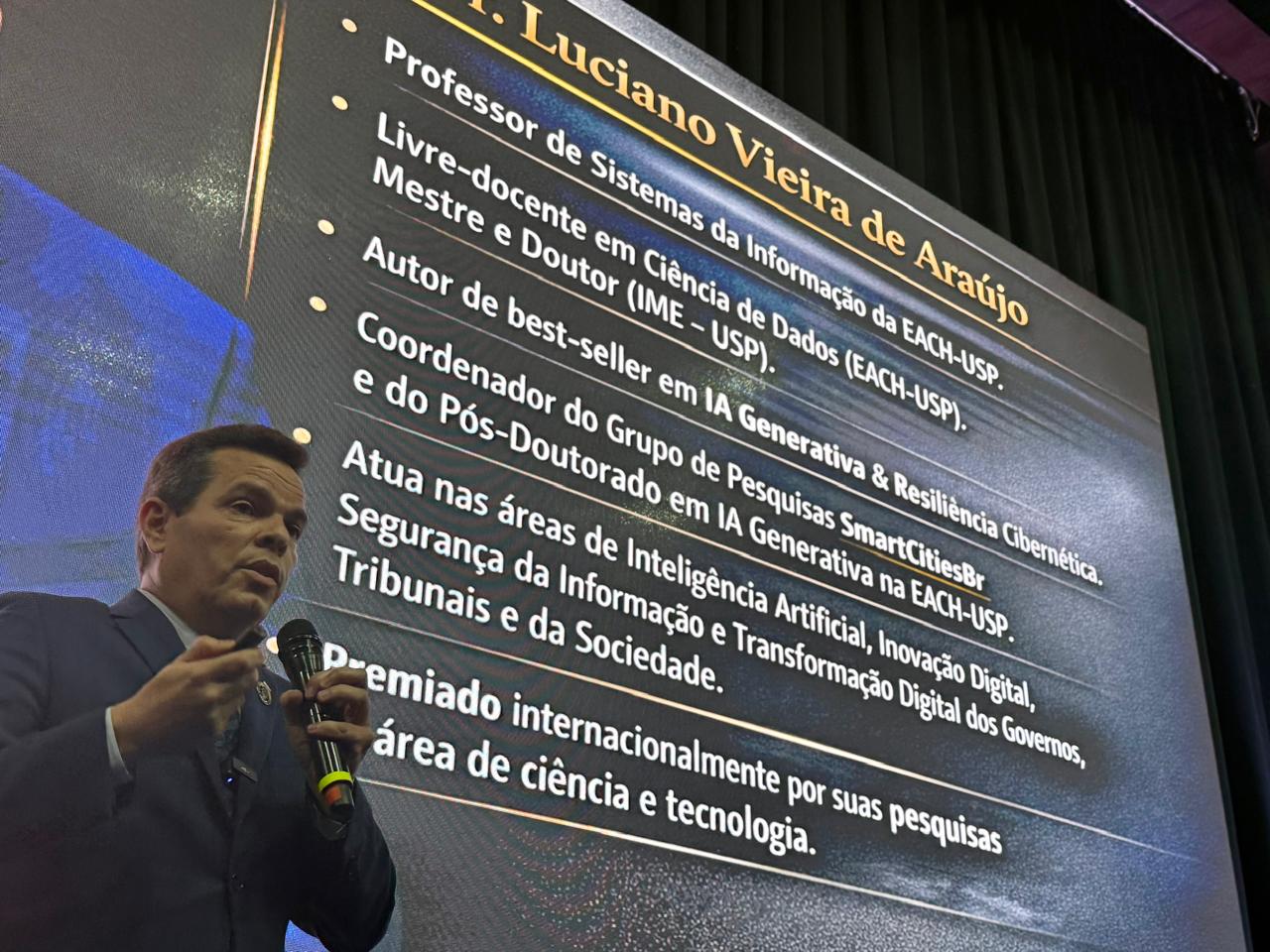

A reflexão foi apresentada no quadro das Jornadas Científicas alusivas ao 30.º aniversário do Tribunal de Contas de Angola, durante a comunicação subordinada ao tema “IA Generativa Activa: Do Texto à Tarefa, do Risco ao Controlo”, integrada no segundo dia do certame.

Esclareceu que o debate em torno da inteligência artificial generativa não deve ser reduzido a uma questão meramente técnica, mas deve ser encarado, sobretudo, como um desafio estratégico para os decisores públicos. Segundo referiu, o mundo entrou já no quarto ano de expansão desta tecnologia, o que permite começar a avaliar, com maior lucidez, tanto as suas potencialidades como os seus limites reais.

Com base em estudos internacionais e na experiência acumulada por grupos de investigação, o professor observou que muitos investimentos feitos em soluções de inteligência artificial generativa não produziram os resultados esperados, precisamente porque a adopção tecnológica foi feita de forma apressada, sem integração adequada com os fluxos institucionais de trabalho e sem enquadramento por critérios de responsabilidade, auditabilidade e controlo.

Neste contexto, advertiu que a inteligência artificial generativa, embora promissora, apresenta riscos objectivos, designadamente a invenção de informação, a alucinação de dados, a oscilação de desempenho, a falta de fiabilidade em determinados contextos e a dificuldade de adaptação automática às exigências jurídicas e procedimentais de instituições complexas, como os tribunais. Por essa razão, sublinhou que a questão central não é apenas saber que tecnologia utilizar, mas antes definir, com rigor, o que se pretende alcançar com ela e, sobretudo, o que não pode ser admitido em hipótese alguma.

Para o académico, a utilização desta tecnologia em instituições de controlo exige que se estabeleçam limites claros: não se pode aceitar que uma solução tecnológica invente dados, contrarie a jurisprudência, ignore normas internas ou produza resultados que não possam ser explicados, validados e auditados. Daí a necessidade de um uso profissional, assistido e institucionalmente moldado, em vez de uma adopção meramente entusiástica ou desregulada.

Foi neste quadro que Luciano Araújo apresentou a noção de Inteligência Artificial Generativa Activa, método que, segundo explicou, visa superar os limites dos modelos baseados unicamente em interfaces conversacionais ou “chats”, introduzindo estruturas de conhecimento mais estáveis, transparentes e compatíveis com os requisitos de instituições públicas. Trata-se, na sua perspectiva, de fazer com que a tecnologia se adapte aos tribunais — e não o contrário.

O prelector explicou que esta abordagem procura garantir que a inteligência artificial possa apoiar tarefas complexas, com elevado volume documental e forte densidade normativa, sem sacrificar a segurança, a responsabilidade nem a capacidade de validação humana. Em vez de substituir o decisor, a tecnologia deve assistir cada etapa do trabalho, tornando mais clara a informação, mais rápida a triagem de dados e mais segura a produção de resultados preliminares.

Ao longo da apresentação, o professor partilhou exemplos práticos de soluções desenvolvidas no contexto brasileiro para tribunais e instituições do sistema de justiça, incluindo provas de conceito aplicadas à análise de contas públicas, admissibilidade de documentos jurídicos e procedimentos de compras públicas. Nestes casos, destacou-se a capacidade da tecnologia para lidar com grandes volumes de informação, cruzar dados complexos e produzir saídas estruturadas, sempre sob parâmetros jurídicos previamente definidos e passíveis de verificação.

Luciano Araújo frisou ainda que uma das maiores preocupações deve recair sobre o impacto da inteligência artificial no quotidiano dos profissionais. Na sua leitura, a tecnologia não reduz automaticamente o trabalho humano; em muitos casos, amplia-o, ao exigir validação, revisão e acompanhamento constantes. Por isso, defendeu que a implementação destas soluções deve ser feita com atenção à realidade das pessoas, evitando sobrecarga, frustração e a ilusão de que todos os quadros de uma instituição terão de se tornar especialistas em “prompts” ou em linguagem técnica de interacção com sistemas.

Em alternativa, propôs que os tribunais invistam em soluções institucionais mais perenes, desenhadas de acordo com as suas necessidades específicas e capazes de absorver a evolução tecnológica sem exigir, a cada nova actualização, uma reconfiguração total das equipas. Para o académico, a maturidade institucional reside precisamente na capacidade de usar a inovação sem abdicar dos princípios que estruturam a função jurisdicional, fiscalizadora e administrativa.

Na parte conclusiva da sua comunicação, Luciano Araújo defendeu que já existem condições para um uso responsável e profissional da inteligência artificial generativa nos tribunais, desde que este uso seja enquadrado por requisitos claros, por padrões de segurança e por uma visão institucional comprometida com o interesse público. Sublinhou, por fim, que o momento actual é particularmente favorável para instituições como o Tribunal de Contas de Angola, por permitir observar experiências internacionais, aprender com os erros já cometidos noutros contextos e escolher, com liberdade e responsabilidade, os caminhos mais adequados à sua própria realidade.

A prelecção do Professor Luciano Araújo trouxe para o centro do debate uma das matérias mais actuais da governação contemporânea: o desafio de integrar a inovação tecnológica no controlo das finanças públicas sem comprometer a legalidade, a fiabilidade da informação e a centralidade da decisão humana.